[ad_1]

Le 11 décembre 2025, le président Donald Trump a signé un décret visant à remplacer les lois nationales sur l’intelligence artificielle que l’administration considère comme un obstacle à l’innovation dans le domaine de l’IA.

Les lois des États réglementant l’IA sont de plus en plus nombreuses, notamment en réponse à la montée en puissance des systèmes d’IA générative tels que ChatGPT qui produisent du texte et des images. Trente-huit États ont adopté des lois en 2025 réglementant l’IA d’une manière ou d’une autre. Elles vont de l’interdiction du harcèlement via des robots alimentés par l’IA à l’interdiction des systèmes d’IA capables de manipuler le comportement des gens.

Le décret déclare que la politique des États-Unis est de produire un cadre national « le moins contraignant possible » pour l’IA. L’ordonnance appelle le procureur général des États-Unis à créer un groupe de travail sur les litiges en matière d’IA pour contester les lois des États sur l’IA qui sont incompatibles avec la politique. Il ordonne également au secrétaire au Commerce d’identifier les lois étatiques « onéreuses » sur l’IA qui entrent en conflit avec la politique et de refuser le financement au titre du programme d’accès et de déploiement du haut débit aux États dotés de ces lois. Le décret exempte les lois des États sur l’IA liées à la sécurité des enfants.

Les décrets sont des directives adressées aux agences fédérales sur la manière de mettre en œuvre les lois existantes. Le décret d’AI ordonne aux ministères et agences fédéraux de prendre des mesures qui, selon l’administration, relèvent de leurs autorités légales.

Les grandes entreprises technologiques ont fait pression sur le gouvernement fédéral pour qu’il déroge aux réglementations nationales en matière d’IA. Les entreprises ont fait valoir que le fardeau du respect des multiples réglementations nationales entrave l’innovation.

Les partisans des lois étatiques ont tendance à les présenter comme des tentatives d’équilibrer la sécurité publique et les avantages économiques. Des exemples frappants sont les lois de la Californie, du Colorado, du Texas et de l’Utah. Voici quelques-unes des principales lois des États réglementant l’IA qui pourraient être ciblées par le décret :

Discrimination algorithmique

La protection des consommateurs pour l’intelligence artificielle du Colorado est la première loi d’État globale aux États-Unis qui vise à réglementer les systèmes d’IA utilisés dans les décisions en matière d’emploi, de logement, de crédit, d’éducation et de soins de santé. Cependant, l’application de la loi a été retardée pendant que le législateur de l’État examine ses ramifications.

La loi du Colorado sur l’IA se concentre sur les systèmes d’intelligence artificielle prédictive, qui prennent des décisions, et non sur l’intelligence artificielle générative plus récente comme ChatGPT, qui crée du contenu.

La loi du Colorado vise à protéger les personnes contre la discrimination algorithmique. La loi oblige les organisations utilisant ces « systèmes à haut risque » à effectuer des évaluations d’impact de la technologie, à informer les consommateurs si l’IA prédictive sera utilisée dans des décisions conséquentes les concernant, et à rendre publics les types de systèmes qu’elles utilisent et la manière dont elles envisagent de gérer les risques de discrimination algorithmique.

Une loi similaire de l’Illinois, qui devrait entrer en vigueur le 1er janvier 2026, modifie la loi sur les droits de l’homme de l’Illinois pour que le fait pour les employeurs d’utiliser des outils d’IA qui entraînent une discrimination constitue une violation des droits civils.

À la « frontière »

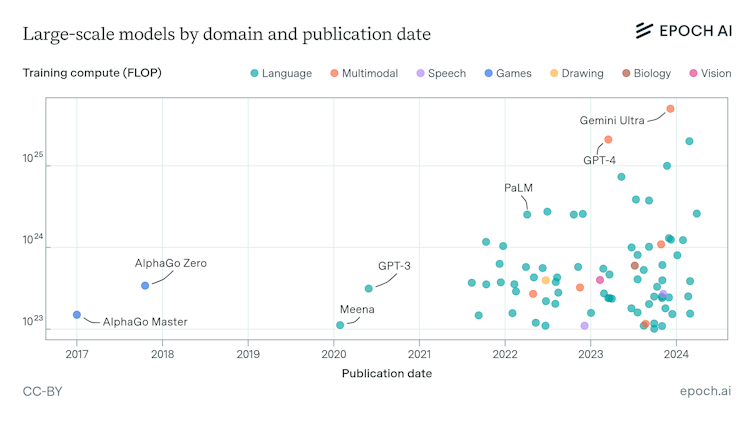

La Transparency in Frontier Artificial Intelligence Act de Californie précise les garde-fous concernant le développement des modèles d’IA les plus puissants. Ces modèles, appelés modèles de base ou modèles frontières, sont tout modèle d’IA formé sur des ensembles de données extrêmement vastes et variés et qui peut être adapté à un large éventail de tâches sans formation supplémentaire. Ils incluent les modèles qui sous-tendent les chatbots ChatGPT d’OpenAI et Gemini AI de Google.

La loi californienne s’applique uniquement aux plus grands modèles d’IA au monde – ceux qui coûtent au moins 100 millions de dollars et nécessitent au moins 1 026 – ou 100 000 000 000 000 000 000 000 000 – opérations de calcul à virgule flottante pour s’entraîner. Les opérations en virgule flottante sont des opérations arithmétiques qui permettent aux ordinateurs de calculer de grands nombres.

Robi Rahman, David Owen et Josh You (2024), « Suivi des modèles d’IA à grande échelle ». Publié en ligne sur epoch.ai., CC BY

Les modèles d’apprentissage automatique peuvent produire des résultats peu fiables, imprévisibles et inexplicables. Cela pose des défis pour réglementer la technologie.

Leur fonctionnement interne est invisible pour les utilisateurs et parfois même pour leurs créateurs, ce qui leur vaut d’être qualifié de boîtes noires. Le Foundation Model Transparency Index montre que ces grands modèles peuvent être assez opaques.

Les risques liés à de tels modèles d’IA incluent l’utilisation malveillante, les dysfonctionnements et les risques systémiques. Ces modèles pourraient potentiellement présenter des risques catastrophiques pour la société. Par exemple, quelqu’un pourrait utiliser un modèle d’IA pour créer une arme provoquant de nombreuses pertes, ou demander à quelqu’un d’orchestrer une cyberattaque causant des milliards de dollars de dégâts.

La loi californienne exige que les développeurs de modèles d’IA de pointe décrivent comment ils intègrent les normes nationales et internationales et les meilleures pratiques consensuelles de l’industrie. Elle leur impose également de fournir un résumé de toute évaluation du risque catastrophique. La loi ordonne également au Bureau des services d’urgence de l’État de mettre en place un mécanisme permettant à quiconque de signaler un incident de sécurité critique et de soumettre confidentiellement des résumés de toute évaluation du potentiel de risque catastrophique.

Divulgations et responsabilité

Le Texas a promulgué le Texas Responsible AI Governance Act, qui impose des restrictions sur le développement et le déploiement de systèmes d’IA à des fins telles que la manipulation comportementale. Les dispositions de la sphère de sécurité – protections contre la responsabilité – de la loi du Texas sur l’IA visent à inciter les entreprises à documenter leur conformité aux cadres de gouvernance responsables de l’IA tels que le cadre de gestion des risques de l’IA du NIST.

Ce qui est nouveau dans la loi texane, c’est qu’elle stipule la création d’un « bac à sable » – un environnement isolé où les logiciels peuvent être testés en toute sécurité – pour que les développeurs puissent tester le comportement d’un système d’IA.

La loi de l’Utah sur la politique en matière d’intelligence artificielle impose des exigences de divulgation aux organisations qui utilisent des outils d’IA générative avec leurs clients. De telles lois garantissent qu’une entreprise utilisant des outils d’IA générative porte la responsabilité ultime des responsabilités et des préjudices qui en résultent pour les consommateurs et ne peut pas rejeter la faute sur l’IA. Cette loi est la première au pays à stipuler la protection des consommateurs et à obliger les entreprises à divulguer de manière visible lorsqu’un consommateur interagit avec un système d’IA générative.

Autres mouvements

Les États prennent également d’autres mesures juridiques et politiques pour protéger leurs citoyens des méfaits potentiels de l’IA.

Le gouverneur républicain de Floride, Ron DeSantis, a déclaré qu’il s’opposait aux efforts fédéraux visant à outrepasser les réglementations des États en matière d’IA. Il a également proposé une déclaration des droits de l’IA en Floride pour faire face aux « dangers évidents » de la technologie.

Pendant ce temps, les procureurs généraux de 38 États et les procureurs généraux du district de Columbia, de Porto Rico, des Samoa américaines et des îles Vierges américaines ont appelé les sociétés d’IA, notamment Anthropic, Apple, Google, Meta, Microsoft, OpenAI, Perplexity AI et xAI, à corriger les résultats flagorneurs et délirants des systèmes d’IA générative. Ce sont des résultats qui peuvent amener les utilisateurs à faire trop confiance aux systèmes d’IA, voire à devenir délirants.

On ne sait pas exactement quel effet aura le décret, et les observateurs ont déclaré qu’il est illégal car seul le Congrès peut remplacer les lois des États. La disposition finale de l’ordonnance ordonne aux fonctionnaires fédéraux de proposer une législation à cet effet.

[ad_2]

Source link